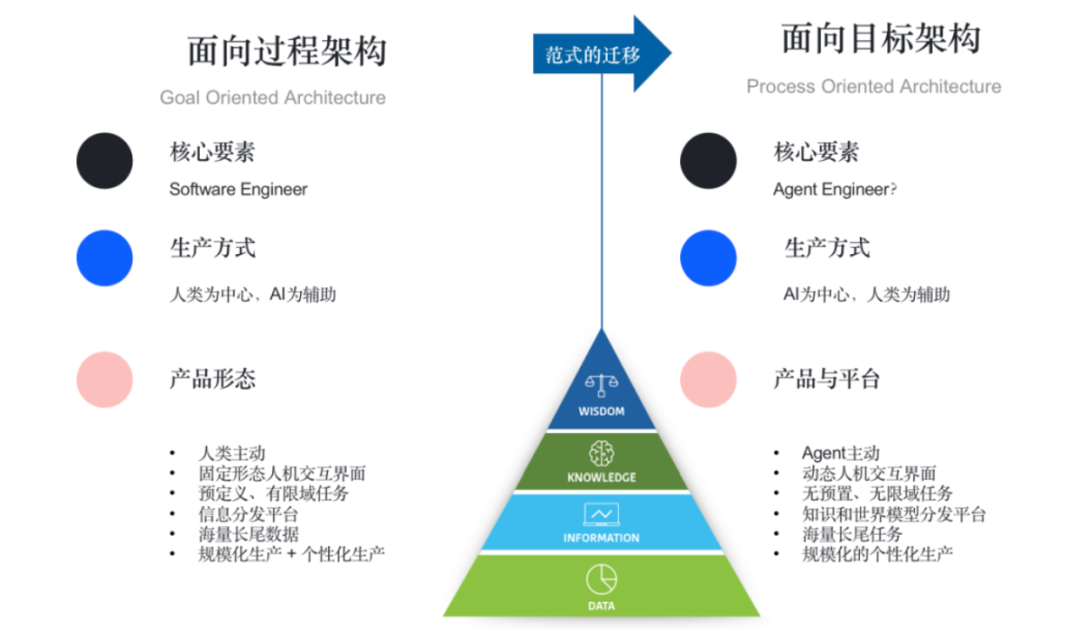

从“立即反应”到“先想后做”:Agent 架构设计的本质差异

一、背景:为什么 Agent 架构正在分化?

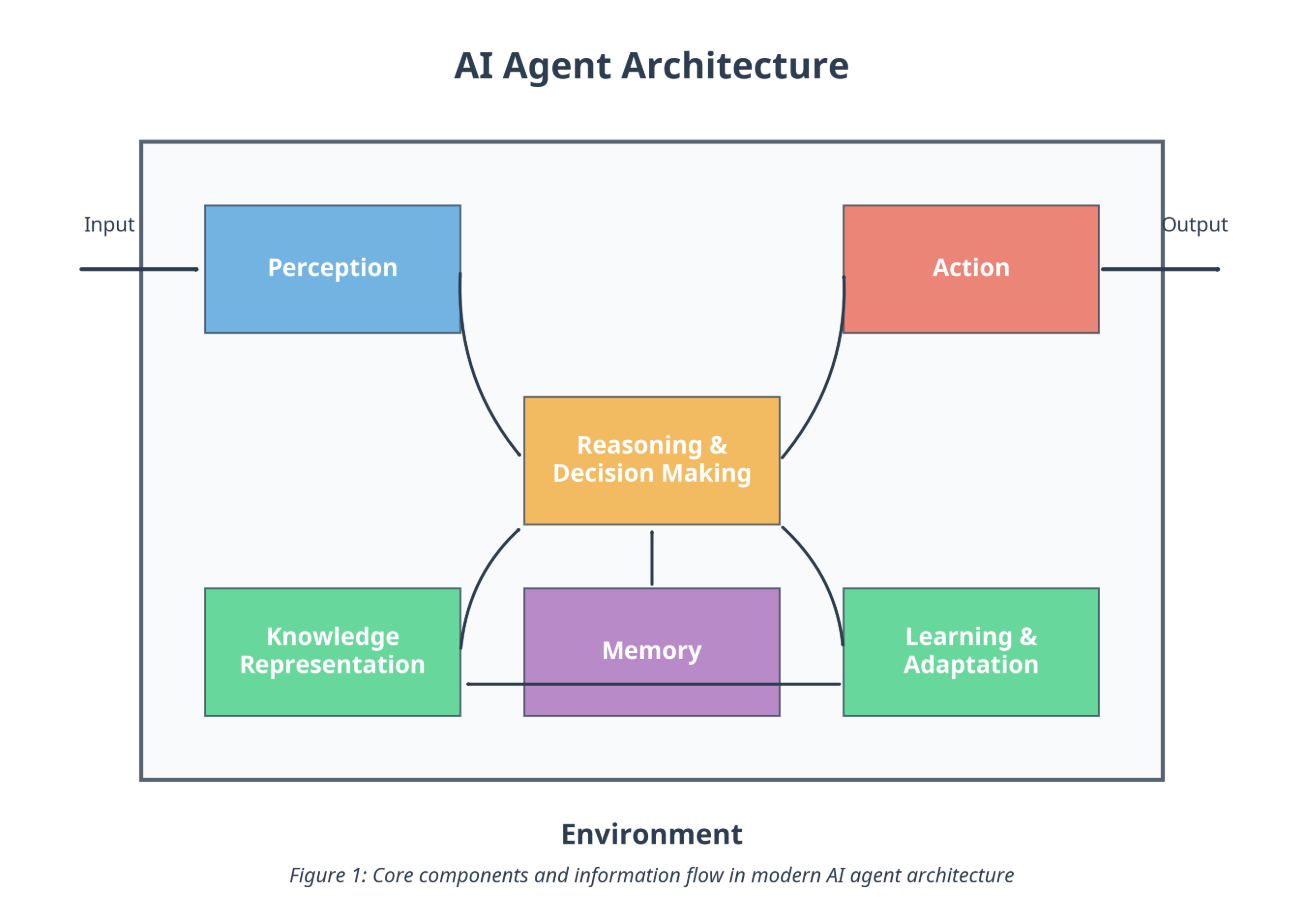

随着大模型(LLM)能力不断增强,**Agent(智能体)**逐渐从“一次性问答”走向“具备决策与行动能力的系统”。在工程实践中,Agent 架构逐渐分化为两大典型范式:

- 反应式 Agent(Reactive Agent)

- 慎思式 Agent(Deliberative / Reasoning Agent)

二者并非能力强弱之分,而是设计哲学与工程取舍的不同。本文将从:

- 架构设计

- 执行流程

- 代码示例

- 场景适配

- 局限性与演进方向

进行系统对比。

二、反应式 Agent:最小决策闭环

2.1 核心思想

反应式 Agent 的本质是:

输入 → 即时决策 → 行动

不做长期规划、不维护复杂状态

它强调 低延迟、强鲁棒、简单可控。

2.2 架构示意

┌─────────┐

│ Input │

└────┬────┘

↓

┌─────────────┐

│ Policy / LLM│ ← 单轮推理

└────┬────────┘

↓

┌─────────┐

│ Action │

└─────────┘

2.3 Python 示例:反应式客服 Agent

class ReactiveAgent:

def decide(self, user_input: str) -> str:

if "退款" in user_input:

return "请前往订单页面申请退款。"

if "价格" in user_input:

return "当前商品价格为 199 元。"

return "我不太明白你的问题,请再描述一下。"

agent = ReactiveAgent()

print(agent.decide("我想退款"))

print(agent.decide("这个多少钱"))

2.4 特点总结

| 维度 | 表现 |

|---|---|

| 推理深度 | ❌ 极浅 |

| 延迟 | ✅ 极低 |

| 状态管理 | ❌ 无 |

| 可解释性 | ✅ 强 |

| 成本 | ✅ 极低 |

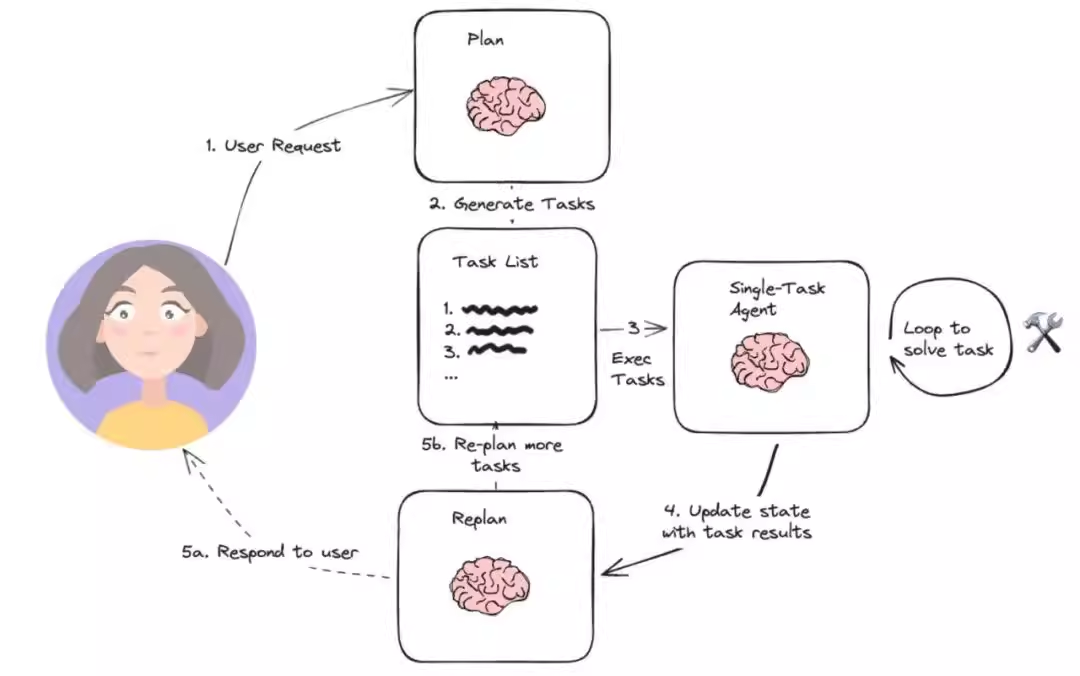

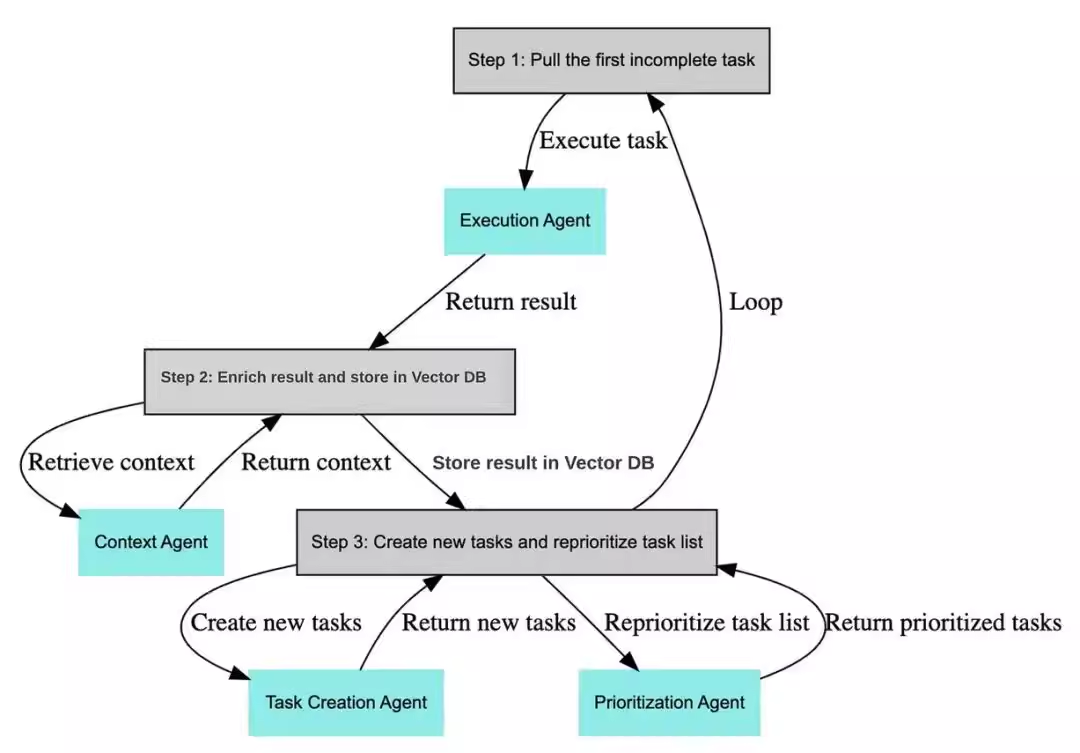

三、慎思式 Agent:以推理驱动行动

3.1 核心思想

慎思式 Agent 的设计理念是:

先想清楚,再行动

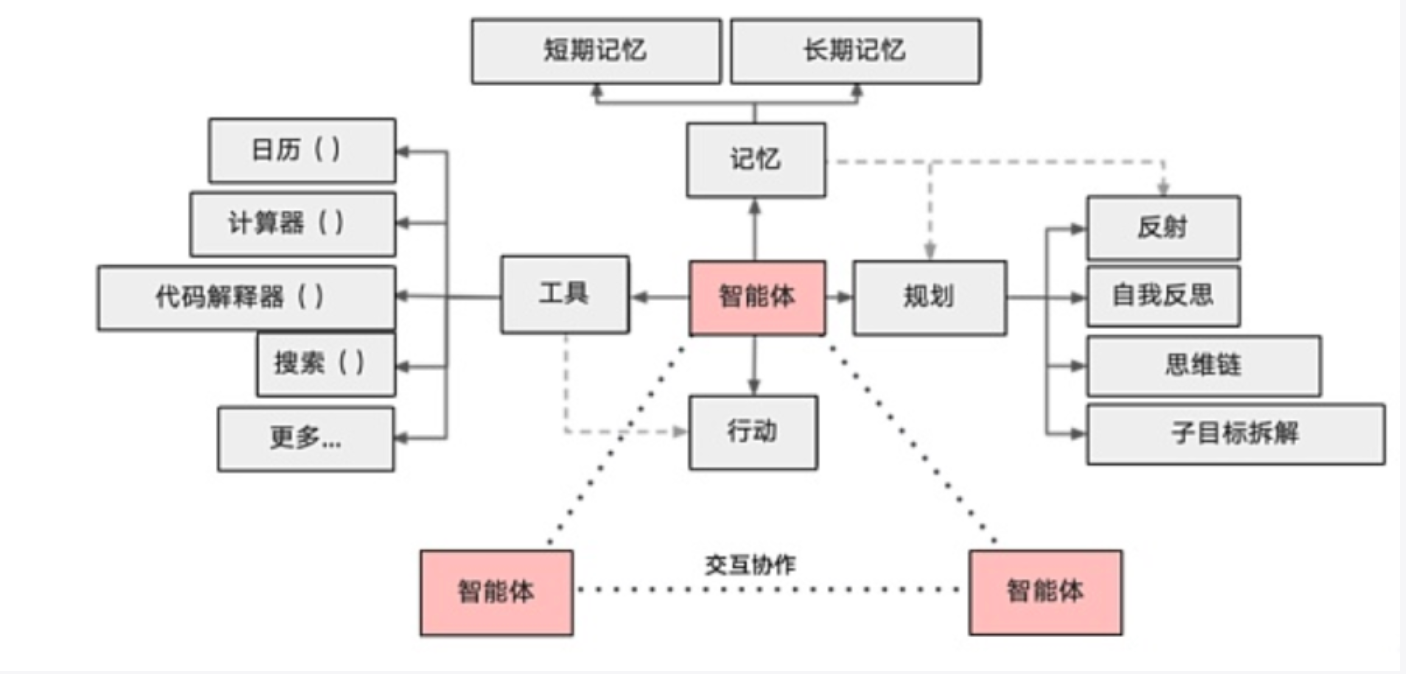

它通常具备以下能力:

- 多步推理(Chain-of-Thought)

- 显式规划(Plan)

- 状态 / 记忆维护

- 工具调用(Tool Use)

3.2 典型架构

┌─────────┐

│ Input │

└────┬────┘

↓

┌──────────────┐

│ Reasoning │ ← 多步思考

│ / Planner │

└────┬─────────┘

↓

┌──────────────┐

│ Tool / Act │

└────┬─────────┘

↓

┌─────────┐

│ Output │

└─────────┘

3.3 Python 示例:慎思式任务 Agent(简化版)

class DeliberativeAgent:

def __init__(self):

self.memory = []

def think(self, goal: str):

steps = [

"理解目标",

"拆解子任务",

"逐步执行"

]

return steps

def act(self, steps):

results = []

for step in steps:

results.append(f"已完成:{step}")

return results

def run(self, goal: str):

steps = self.think(goal)

self.memory.append((goal, steps))

return self.act(steps)

agent = DeliberativeAgent()

result = agent.run("帮我生成一篇 AI 技术博客")

for r in result:

print(r)

3.4 特点总结

| 维度 | 表现 |

|---|---|

| 推理深度 | ✅ 强 |

| 延迟 | ❌ 较高 |

| 状态管理 | ✅ 有 |

| 可解释性 | ⚠️ 依赖日志 |

| 成本 | ❌ 较高 |

四、核心差异对比

| 维度 | 反应式 Agent | 慎思式 Agent |

|---|---|---|

| 决策方式 | 即时反应 | 推理 + 规划 |

| 执行模式 | 单轮 | 多轮 |

| 是否有记忆 | ❌ | ✅ |

| 工程复杂度 | ⭐ | ⭐⭐⭐⭐ |

| 适合场景 | 高频、简单 | 复杂、长链路 |

五、典型适用场景分析

5.1 反应式 Agent 适合什么?

✅ 强实时性场景

- 实时风控规则

- 自动告警响应

- 聊天机器人 FAQ

- 游戏 NPC 行为

🚫 不适合:

- 多约束决策

- 复杂任务拆解

- 长期目标优化

5.2 慎思式 Agent 适合什么?

✅ 复杂任务场景

- AutoGPT / LangGraph

- 数据分析 Agent

- 自动化运维(AIOps)

- 多工具协同任务

🚫 不适合:

- 极低延迟系统

- 高并发在线请求

- 成本敏感型业务

六、工程实践中的真实问题

6.1 慎思式 Agent 的现实瓶颈

- 推理成本不可控

- 错误会被层层放大

- 调试难度极高

- 状态一致性问题

6.2 反应式 Agent 的能力天花板

- 无法自我纠错

- 无法跨步骤优化

- 表达能力有限

七、趋势:混合式 Agent(Hybrid Agent)

真实工程中,最优解往往不是二选一。

高频路径 → 反应式

复杂路径 → 慎思式

典型模式:

def hybrid_agent(input):

if is_simple(input):

return reactive_agent(input)

else:

return deliberative_agent(input)

这也是 当前生产级 Agent 系统的主流设计。

八、总结

Agent 架构的选择,本质是工程约束下的权衡

- 反应式 Agent:快、稳、省

- 慎思式 Agent:强、灵活、复杂

真正成熟的 Agent 系统,往往是 反应式作为地基,慎思式作为能力增强层。

反应式 Agent 与慎思式 Agent 并不是“先进与落后”的关系,而是面向不同工程约束的两种理性选择。前者以规则或单轮推理为核心,追求低延迟、高稳定性和可控成本,适合高并发、强实时、逻辑相对固定的业务场景;后者则通过多步推理、显式规划与状态记忆,解决复杂决策与长链路任务,但同时带来了更高的系统复杂度与成本不确定性。

在真实生产环境中,单一范式往往难以覆盖全部需求,越来越多的系统采用混合式 Agent 架构:用反应式 Agent 承担高频、确定性路径,用慎思式 Agent 处理复杂、低频但高价值的任务。这种分层与协同的设计,正在成为构建可落地、可扩展 Agent 系统的主流方向。

- 点赞

- 收藏

- 关注作者

评论(0)